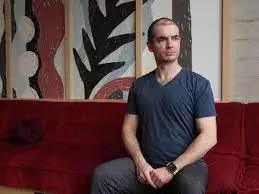

Ilya Sutskever lance Safe Superintelligence Inc. après avoir quitté OpenAI

Rompre Entreprise d'IA

Ilya Sutskever, co-fondateur d'OpenAI, a annoncé le lancement d'une startup rivale en matière d'IA, Safe Superintelligence (SSI) Inc., un mois seulement après son départ de OpenAI suite à une tentative de coup d'État infructueuse contre son PDG, Sam Altman. Sutskever, l'une des personnalités les plus respectées de la recherche en IA, a révélé que SSI vise à construire une « superintelligence sûre » et l'a décrit comme le premier laboratoire SSI au monde dédié à un seul objectif et à un seul produit.

Sutskever a présenté mercredi Safe Superintelligence (SSI) Inc. Il est présenté comme le laboratoire SSI pionnier et simple à l'échelle mondiale, uniquement axé sur la création d'une superintelligence sûre, comme indiqué dans une annonce sur X.

Équipe fondatrice et vision

SSI a été cofondée par Sutskever avec l'ancien OpenAI l'employé Daniel Levy et l'investisseur et entrepreneur en IA Daniel Gross. Gross, ancien partenaire chez Y Combinator, détient des participations dans plusieurs sociétés, dont GitHub, Instacart et des entreprises d'IA comme Perplexity.ai et Character.ai. Bien que les investisseurs dans SSI n'aient pas été divulgués, les fondateurs soulignent que l'objectif principal de l'entreprise est le développement d'une superintelligence sûre, libre de toute pression sur les revenus. Selon eux, cette orientation unique attirera les meilleurs talents vers leur initiative.

Positionnement stratégique et comparaison avec OpenAI

Sutskever et ses co-fondateurs ont souligné que la mission dédiée de SSI à la sécurité de la superintelligence ne signifie aucune distraction des frais généraux de gestion ou des cycles de produits. Cette approche contraste avec OpenAI, qui, bien qu'initialement fondé comme un laboratoire de recherche à but non lucratif, est devenu une entreprise à croissance rapide sous la direction d'Altman. Malgré les affirmations d'Altman selon lesquelles la mission principale d'OpenAI reste inchangée, la nouvelle entreprise de Sutskever cherche à rester uniquement axée sur la sécurité et le progrès, sans contraintes commerciales. SSI aura son siège à Palo Alto et à Tel Aviv.

Contexte et troubles récents chez OpenAI

Le départ de Sutskever d'OpenAI fait suite à une période de conflit interne sur l'orientation de l'entreprise et les priorités en matière de sécurité. En novembre, Sutskever et d’autres administrateurs ont décidé d’évincer Altman de son poste de PDG, une décision qui a choqué les investisseurs et le personnel. Altman a repris ses fonctions quelques jours plus tard, sous la direction d'un nouveau conseil d'administration, et Sutskever a ensuite quitté l'entreprise en mai, exprimant son enthousiasme pour son nouveau projet personnellement significatif.

Sécessions précédentes et défis de l’industrie

Sutskever n'est pas le premier dirigeant d'OpenAI à quitter l'entreprise et à poursuivre des initiatives d'IA sûre. En 2021, Dario Amodei, ancien responsable de la sécurité de l'IA chez OpenAI, a fondé Anthropic, qui a depuis levé $4 milliards auprès d'Amazon et des centaines de millions supplémentaires auprès d'investisseurs en capital-risque, atteignant une valorisation de plus de $18 milliards. Autre départ récent, Jan Leike, qui a travaillé en étroite collaboration avec Sutskever, a rejoint Anthropic après avoir exprimé ses inquiétudes quant au fait que la culture de sécurité d'OpenAI était mise de côté au profit du développement de produits.

Découvrez l'autre Actualités sur l'IA et événements technologiques ici dans AIfuturize!