Vale la pena notare che questa tecnologia innovativa non solo può identificare i tumori ma anche interagire con gli utenti, fornendo nuovi strumenti e prospettive per la diagnosi e la ricerca in patologia.

PathChat: assistente AI per il rilevamento di patologie multimodali

Per molti anni, la patologia computazionale ha compiuto progressi significativi nell'analisi dei dati morfologici patologici e dei dati di rilevamento molecolare. Questo campo di ricerca di nicchia, formato dall’intersezione della patologia con l’intelligenza artificiale e le tecnologie di visione artificiale, sta gradualmente diventando un punto caldo della ricerca nell’analisi delle immagini mediche.

La patologia computazionale prevede l'utilizzo dell'elaborazione delle immagini e della tecnologia AI per costruire modelli di patologia computazionale AI. Questi modelli acquisiscono immagini istopatologiche e conducono valutazioni preliminari dell'aspetto morfologico di queste immagini per assistere nella diagnosi, nella valutazione quantitativa e nel processo decisionale attraverso tecniche automatizzate di analisi delle immagini.

Attualmente, con la crescita esplosiva delle tecnologie di intelligenza artificiale generativa rappresentate da ChatGPT, i modelli multimodali di linguaggio di grandi dimensioni (MLLM) vengono sempre più applicati nella ricerca sulla patologia computazionale e nella pratica clinica in patologia. Tuttavia, nel sottocampo altamente specializzato dell’anatomia patologica, la ricerca sulla costruzione di assistenti IA generali e multimodali per la patologia è ancora nelle fasi iniziali.

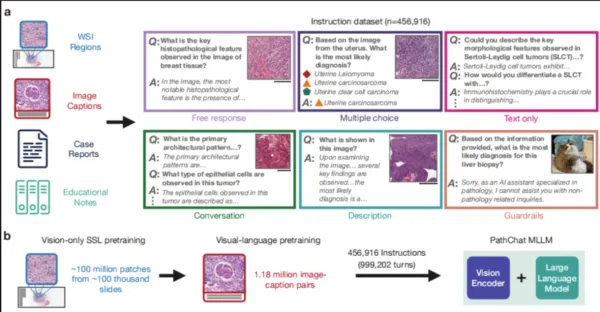

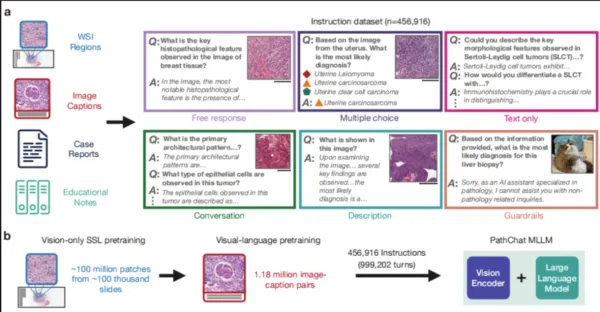

In questo lavoro, il gruppo di ricerca ha progettato un assistente AI generativo multimodale specifico per la ricerca sulla patologia umana: PathChat. Hanno pre-addestrato il sistema attraverso l'apprendimento auto-supervisionato su oltre 100 milioni di frammenti di immagini di tessuti cellulari provenienti da più di 1 milione di vetrini. Combinando questo con un codificatore visivo puro all'avanguardia, UNI, hanno generato un MLLM in grado di ragionare sugli input sia visivi che del linguaggio naturale. Dopo aver messo a punto un set di dati di oltre 450.000 punti dati di istruzioni, è stato costruito PathChat.

La ricerca ha scoperto che PathChat non solo può gestire input multimodali, ma anche rispondere accuratamente a complesse domande relative alla patologia, identificando correttamente le malattie dai vetrini bioptici in quasi 90% di casi.

PathCht

Superando GPT-4V con una precisione quasi 90%

Per testare le prestazioni di rilevamento di PathChat, il team di ricerca ha confrontato PathChat con il modello open source LLaVA, il modello biomedico LLaVA-Med e GPT-4V.

Hanno progettato l’esperimento di confronto PathQABench, analizzando casi patologici di diversi organi e pratiche per confrontare le prestazioni di rilevamento di PathChat con LLaVA, LLaVA-Med e GPT-4V.

I risultati hanno mostrato che senza fornire un contesto clinico, l'accuratezza diagnostica di PathChat era significativamente più elevata rispetto a LLaVA 1.5 e LLaVA-Med. Valutando le sole immagini, PathChat ha raggiunto una precisione di 78,1% su tutti i benchmark combinati, ovvero 52,4% superiore a LLaVA 1.5 e 63,8% superiore a LLaVA-Med.

Includendo il contesto clinico, la precisione di PathChat è ulteriormente aumentata a 89,5%, ovvero 39,0% superiore a LLaVA 1,5 e 60,9% superiore a LLaVA-Med.

L'esperimento comparativo ha rivelato che PathChat può trarre una sostanziale capacità predittiva dalle sole caratteristiche visive delle immagini, piuttosto che fare affidamento esclusivamente sul contesto clinico. Può utilizzare in modo efficace e flessibile informazioni multimodali per diagnosticare accuratamente immagini istologiche incorporando informazioni non visive fornite attraverso il linguaggio naturale ordinario.

Per valutare oggettivamente l'accuratezza delle risposte di ciascun modello alle domande aperte, il gruppo di ricerca ha reclutato sette patologi per formare un gruppo di valutazione. Confrontando le risposte dei quattro modelli a 260 domande a risposta aperta, è stata analizzata l'accuratezza dei rilevamenti del modello.

Infine, sulle domande a risposta aperta in cui i sette esperti hanno potuto raggiungere un consenso, la precisione complessiva di PathChat è stata di 78,7%, ovvero 26,4%, 48,9% e 48,1% superiore rispettivamente a GPT-4V, LLaVA 1,5 e LLaVA-Med. Nel complesso, PathChat ha dimostrato prestazioni superiori rispetto agli altri tre modelli.

I ricercatori hanno indicato che PathChat può analizzare e descrivere sottili dettagli morfologici nelle immagini dei tessuti patologici. Oltre agli input di immagini, può anche rispondere a domande che richiedono conoscenze di patologia e di base biomedica generale, rendendolo uno strumento promettente per assistere patologi e ricercatori.

Nonostante le eccellenti prestazioni di PathChat negli esperimenti, deve ancora affrontare alcune sfide nelle applicazioni pratiche. Questi includono garantire che il modello possa identificare query non valide ed evitare risultati errati, mantenere la sincronizzazione con le più recenti conoscenze mediche e affrontare il fatto che i dati di addestramento di PathChat provengono principalmente da dati storici, che potrebbero riflettere il "consenso scientifico passato" piuttosto che le informazioni più recenti.

I ricercatori hanno affermato che studi futuri potrebbero migliorare ulteriormente le capacità di PathChat, incluso il supporto dell'intero WSI gigapixel o più input WSI e l'integrazione di un supporto più specifico per attività, come il conteggio preciso o la localizzazione degli oggetti. Inoltre, l'integrazione di PathChat con visualizzatori di diapositive digitali o cartelle cliniche elettroniche potrebbe migliorarne ulteriormente la praticità nella pratica clinica.

Recentemente è stato rilasciato il modello di intelligenza artificiale generativa multimodale PathChat 2. Può ragionare su immagini e testo della patologia, accettando input alternati di più immagini e testo ad alta risoluzione in un visualizzatore di diapositive interattivo, fornendo così valutazioni più complete per ciascun caso di consultazione.

Rispetto a PathChat 1, ha migliorato significativamente le prestazioni nella diagnosi differenziale e nella descrizione morfologica. Dispone inoltre di funzionalità migliorate in attività quali il seguito di istruzioni, la risposta a domande aperte e il riepilogo dei report.